|

- 僯儏乕儔儖僱僢僩儚乕僋偲偼

- 捈栿偡傟偽乽恄宱夞楬栐乿偺偙偲偱偁傝丆尩枾偵偼

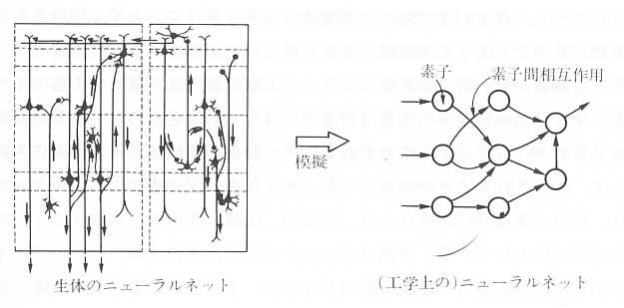

丆惗懱偺恄宱宯偺僱僢僩儚乕僋傪堄枴偡傞尵梩偱偁傞丏僯儏乕儔儖僱僢僩偺堦椺傪Fig偵帵偡丏恾偺傛偆偵惗懱偺恄宱嵶朎乮僯儏乕儘儞乯傪柾媅偟偨恖岺偺慺巕傪憡屳偵愙懕偟偰峔惉偝傟傞僱僢僩儚乕僋偺偙偲傪僯儏乕儔儖僱僢僩偲屇傇丏 丆惗懱偺恄宱宯偺僱僢僩儚乕僋傪堄枴偡傞尵梩偱偁傞丏僯儏乕儔儖僱僢僩偺堦椺傪Fig偵帵偡丏恾偺傛偆偵惗懱偺恄宱嵶朎乮僯儏乕儘儞乯傪柾媅偟偨恖岺偺慺巕傪憡屳偵愙懕偟偰峔惉偝傟傞僱僢僩儚乕僋偺偙偲傪僯儏乕儔儖僱僢僩偲屇傇丏

- 僶僢僋僾儘僷僎乕僔儑儞

- D.E.R倀俵俤俴俫俙俼俿傜偵傛傝1986擭偵採埬偝傟偨嫵巘晅偒妛廗朄偱丆擖椡憌丒弌椡憌偍傛傃侾偮埲忋偺拞娫憌偱峔惉偝傟傞懡曄悢旕慄宍嵟彫壔栤戣偵偍偗傞妋棪揑崀壓朄偺堦庬偱偁傞丅

-

- 僔僌儌僀僪娭悢

- sigmoid(倶)亖侾乛乷侾亄exp乮亅俀倶乛兪侽乯乸

- 兪侽偼嬋慄偺孹偒傪昞偡僷儔儊乕僞偱偁傞丅偙偺兪侽偑彫偝偄偲倶亖侽晅嬤偱嬋慄偺孹偒偑戝偒偔側傝丆僗僥僢僾娭悢偲摨條偺摥偒傪偡傞傛偆偵側傞丅

- 僶僢僋僾儘僷僎乕僔儑儞偺夵椙偁傟偙傟

- 儌乕儊儞僩朄乮姷惈棪朄乯

- BP朄偱偼廳傒學悢wji丄skj偺廋惓検(峏怴抣)儮wji丄儮skj偼偦偺帪偺弌椡憌偵偍偗傞岆嵎傊偺婑梌検偩偗偐傜媮傔偰偄偨偑丄儌乕儊儞僩朄偱偼慜夞偺廋惓検傕峫椂偡傞曽朄偱偁傞丅

-

- 摿堎揰夝徚朄

-

BP朄偱偼丄嫵巘怣崋(栚揑弌椡)偲幚嵺偺弌椡偑堦抳偡傞応崌偺懠偵丄拞娫憌偺弌椡偍傛傃丄弌椡憌偺弌椡抣偑0傪偲傞応崌丄廳傒偺廋惓偑峴傢傟側偄丅傑偨丄弌椡娭悢偺摫娭悢偼嵟崅偱傕0.25偟偐側偔丄妛廗(廳傒學悢偺廋惓)偵帪娫偑偐偐傞丅偙偺傛偆側摿堎揰傪彍偒丄岆嵎媡揱攄検傪偁傞掱搙戝偒偔偟偰妛廗懍搙傪忋偘傞偨傔偵幃傪廋惓偡傞曽朄丅

- 棙梡忋偺僐僣側偳

- 幚嵺偺嫵巘怣崋偵庒姳偺僲僀僘傪壛偊偨僨乕僞傪妛廗偝偣傞偙偲偱丆僱僢僩儚乕僋偺堦斒壔擻椡偑岦忋偡傞丏

- 僨乕僞僙僢僩悢偵懳偟偰拞娫憌偺悢偑懡偄偲偒偵孞傝曉偟妛廗傪恑峴偝偣傞偲夁妛廗傪惗偠傞丏

- 拞娫憌偺儐僯僢僩悢偺寛掕

- 擖椡憌悢傪値偲偟偨帪丆俀値亄侾偱桳岠偱偁傞偲偡傞傕偺

- 俀値乛俁偱廫暘偱偁傞偲偡傞傕偺

- 愒抮偺忣曬検婯弨乮AIC:akaike's information criterion乯傪梡偄傞傕偺

- NIC丒丒孭楙僨乕僞忋偱擟堄偺擖椡怣崋偵懳偡傞儌僨儖偐傜偺弌椡偲嫵巘怣崋乮惓夝乯偲偺乭偢傟乭偵拞娫憌偺儐僯僢僩悢傪壛偊偨傕偺偱昡壙偡傞曽朄

- 偟偐偟丆棟榑揑側曽朄偑懚嵼偡傞傢偗偱偼側偔丆奺儌僨儖偛偲偵帋峴嶖岆揑偵寛掕偡傞偺偑尰忬

- 戝堟揑嵟彫抣偵廂懇偝偣傞偨傔偺僐僣

- Simulated annealing(從偒側傑偟朄)傪暪梡偡傞曽朄

- 廳傒仌鑷抣偺廋惓幃偵兲傪壛偊傞

- 兲丗暯嬒0偱丆暘嶶T(s)偺惓婯棎悢崁

- 娭楢崁栚

- 嵟媫岡攝朄

- 從偒側傑偟朄丒僔儈儏儗乕僥僢僪丒傾僯乕儕儞僌

- 廳夞婣暘愅

-

- 僀儞僞乕僱僢僩忣曬尮

- 娭楢彂愋

[慜夋柺偵栠傞]

|